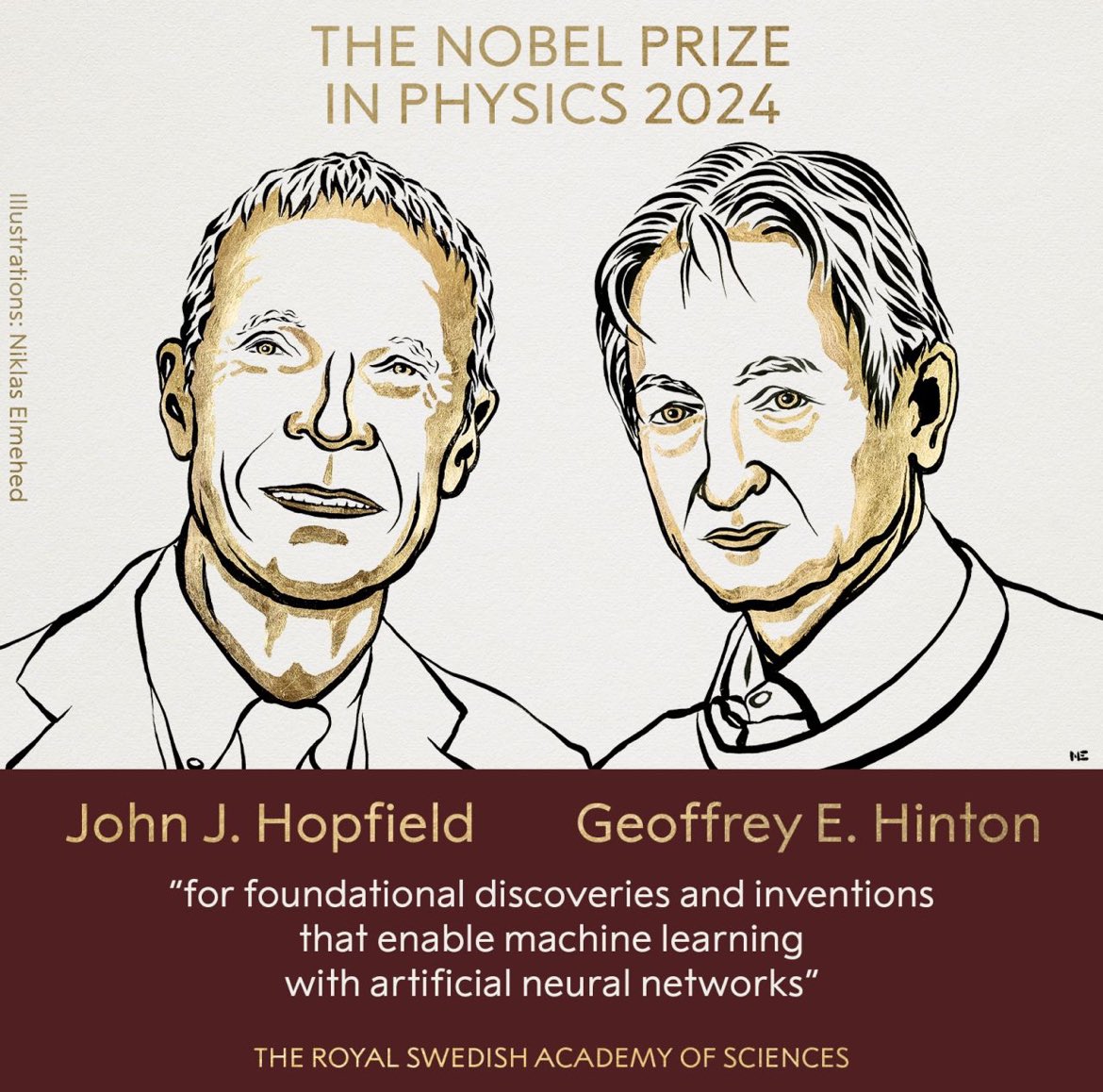

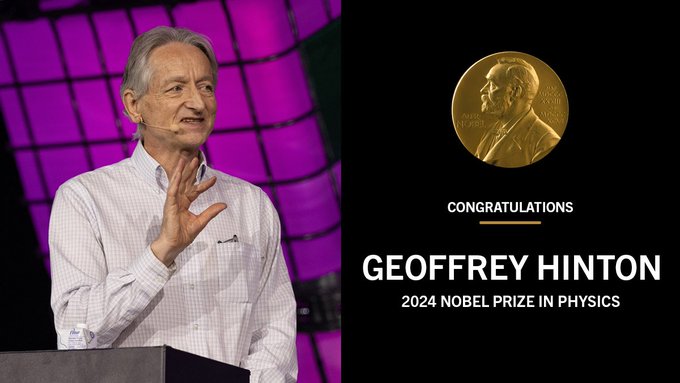

Dün öğleden sonraki saatlerde açıklanan Nobel Fizik Ödülü'nün ardından bilim dünyasında beklenebilecek bir tartışma başladı.2024 Nobel Fizik Ödülü, yapay zeka (AI) alanındaki öncü çalışmaları nedeniyle Prof. John Hopfield ve Prof. Geoffrey Hinton'a verildi. En yaygın yorumlardan biri de 'Pişman olmuş adama Nobel verdiler!' şeklinde… Çünkü ödülün ortaklarından Prof. Hinton, 'Yapay zeka çalışmalarımdan çok pişmanım. Gelişmeler korkunç,' diyerek geçen yıl Google'dan istifa etmişti. O profesör dün Nobel Fizik ödülü aldı. Yapay sinir ağlarıyla makine öğrenimini mümkün kılan keşfi için.

Hopfield, 1980'lerde yapay sinir ağları üzerine yaptığı çalışmalarla, özellikle hatalı verilerden görüntü veya desenleri yeniden oluşturabilen 'Hopfield ağı' ile tanınıyor. Hinton ise Hopfield'ın çalışmalarını geliştirerek 'Boltzmann makinesi' adını verdiği yöntemle, veri örüntülerini sınıflandırabilen ve yeni örnekler yaratabilen sinir ağlarını geliştirdi. Bu araştırmalar, günümüzde yapay zeka ve derin öğrenme teknolojilerinin temelini oluşturdu.

Bu iki bilim insanının katkıları, yapay zekanın günümüzdeki hızlı ilerlemesini sağladı ve birçok alanda, özellikle sağlık ve üretkenlikte büyük gelişmeler yaşanmasına zemin hazırladı. Hinton, teknolojisinin etkisini değerlendirirken bunun sanayi devrimi kadar büyük bir dönüşüm yaratacağını ifade etti. Ancak, dün Nobel Komitesi'nin de vurguladığı gibi 'bu teknolojilerin getirdiği fırsatlar kadar, kontrol edilemez hale gelmesi gibi olumsuz sonuçlara da dikkat çekmiştir'

Bence de bu ödül, yapay zekanın bilimsel ilerlemelere katkısının dünya çapında tanınmasını sağlaması açısından oldukça önemli. Nobel Komitesi de gelişmelerin sorumlu bir şekilde yönlendirilmesi gerektiği de özellikle vurgulamış görüldüğü üzere.

Ödül açıklanınca sosyal medyada Geoffrey E. Hinton'un şu sözleri hemen dolaşıma sokuldu: 'Ben bir sosyalistim. Medyanın ve 'bilgi işlem araçlarının' özel mülkiyetinin iyi olmadığını düşünüyorum' İmza: Yapay zekanın vaftiz babası ve bugün Fizik Nobel Ödülü sahibiHinton.

Hinton, hayatı boyunca yaptığı çalışmalardan dolayı pişmanlık duyduğunu itiraf etmiş ve yapay zekanın kontrolsüz bir şekilde gelişmesi halinde insanlık için büyük tehlikeler yaratabileceğini belirtmiştir. Google'dan ayrıldıktan sonra, yapay zekanın hızla ve düzenlenmeden geliştirilmesinin doğurabileceği risklere karşı uyarılarda bulunmaya başlamıştır. Özellikle kötü niyetli aktörlerin bu teknolojiyi manipülasyon ve kontrol amaçlı kullanabileceği konusunda halen de endişeli. Hinton, atom bombasının geliştirilmesine öncülük eden Robert Oppenheimer ile de karşılaştırmalar yapmış ve büyük riskler taşıyan çığır açıcı teknolojilerin peşinden gitmenin ahlaki zorluklar barındırdığını öne sürmüştü. Hinton, yapay zekanın potansiyel tehlikelerini vurgulamış, özellikle makinelerin insan niyetlerinden sapabilecek yan amaçlar geliştirme olasılığına dikkat çekmişti.

Ben de biraz araştırıp röportajın tamamını buldum. Geoffrey E. Hinton'un dedikleri tam olarak şöyle: 'Eğer Google'ın kapitalist bir sistem bağlamında ne yaptığını incelerseniz, beklenebilecek ölçüde sorumlu davrandığını göreceksiniz. Ama bu, tüm insanlar için faydayı en üst düzeye çıkarmaya çalıştığı anlamına gelmez: Yasal olarak hissedarları için faydayı en üst düzeye çıkarmakla yükümlüdür ve bu çok farklı bir şeydir.Otoriter hükümetlerinsanlığın yapay zekanın risklerini kontrol altına alabilmeden önce çok geç olacağına işaret eden en büyük tehlike sinyalidir.'

Şöyle devam etmiş: 'Bu tür şeyler, otoriter hükümetlerin gerçeği yok etmesine ya da seçmenleri manipüle etmesine yardımcı oluyor. Ve Amerikalıların ergenlik çağındaki çocuklara saldırı tüfekleri vermeme konusunda bile anlaşamadığı bir durumda, bu tehditlerle başa çıkmak zorunda kalmak pek de düşünmesi zor bir şey değil.'

Konuştuğum bizim bilim insanlarının yorumları da farklı değil: '2024 Nobel Fizik Ödülü'nün yapay sinir ağları alanında öncü çalışmaları olan ve Geoffrey veHinton'a verilmesi büyük ölçüde haklı olarak değerlendirilebilir. İki bilim insanının da yapay zeka ve makine öğrenimi teknolojilerinin temelini atan çalışmaları, günümüzün hızla gelişen AI devrimini mümkün kılan köşe taşlarıdır.'

Hopfield'ın sinir ağlarıyla ilgili çalışması, özellikle bellek ve hatırlama üzerine yapılan araştırmalarda devrim yaratmış, Hinton ise bu ağları geliştirerek derin öğrenme alanına öncülük etmiş.

Bu çalışmalar, hakikaten de tıpkı sanayi devrimi gibi, geniş çapta teknolojik ilerlemelere kapı açmıştır. Derin öğrenme ve yapay zeka, sağlık, üretim, malzeme bilimi ve daha birçok alanda devrim niteliğinde yenilikler getirmiştir?.

Nobel ödüllerinin bilimde temel değişiklikler ve büyük toplumsal katkılar yapan buluşlara verildiği düşünüldüğünde, bu ödülün haklı olduğu söylenebilir.

Ancak, bazı eleştiriler de mevcut. AI'nın hızla gelişmesinin hem faydaları hem de olası olumsuz sonuçları var. Hinton bile, teknolojinin kontrol edilemez hale gelme riskine dikkat çekiyor. Bu nedenle, ödülün haklılığı, bu teknolojinin ne kadar sorumlu kullanıldığına bağlı olarak da tartışılabilir.

Yapay zekanın (AI) geleceği konusunda kaygı duyan birçok uzman ve bilim insanı var.

En önemli sorun 'Kontrol Kaybı'AI'nın insanlardan daha zeki hale gelmesi durumunda kontrolü kaybetme endişesi sıkça dile getiriliyor. 'Yapay zekanın vaftiz babası'Hinton bile, teknolojinin kontrolden çıkma olasılığı konusunda uyarılarda bulunmuş okuduğunuz gibi. AI'nın karar verme süreçlerinin insan müdahalesine gerek kalmadan işlemesi, öngörülemeyen ve olumsuz sonuçlar doğurabilir?.

Dünyanın temel dertlerinden biri istihdam. Yapay zekanın gelişimi ile birlikte birçok işin otomasyonla yer değiştireceği düşünülüyor. Özellikle tekrarlı görevlerde, yapay zeka insan iş gücünün yerini alabilir. Bu da geniş çapta işsizlik, ekonomik eşitsizlik ve sosyal sorunlara yol açabilir.

Yanlılık ve Manipülasyon bence en önemli problem: AI sistemlerinin tarafsız olmadığı, onları eğiten verilerdeki önyargıları yansıttığı biliniyor. AI, yanlış bilgiler yayma, manipülasyon veya toplumda bölünmelere neden olma potansiyeline sahip. Özellikle otoriter rejimlerde bu teknolojiler, seçmenleri manipüle etmek ya da toplumu kontrol etmek için kullanılabilir.

Askeri alandaki sıkıntılar. AI'nın askeri alanda kullanımı, silah sistemlerinin otonom hale gelmesiyle yeni güvenlik tehditleri ortaya çıkarabilir. Otonom silahların kontrol edilmesi zor olabilir ve etik sorunlar doğurabilir. AI'nın büyük miktarda veri gerektirmesi, kişisel gizliliğin ihlal edilmesi ve bireylerin izlenmesi riskini doğurur. Büyük teknoloji şirketlerinin AI'yı kullanarak veri toplama süreçleri bu konuda endişe yaratıyor.

Bu nedenlerle, AI teknolojilerinin gelişimini dikkatle izlemek ve düzenleyici mekanizmaların oluşturulması gerektiği sık sık vurgulanıyor. AI'nın potansiyel faydaları kadar olumsuz etkilerinin de farkında olmak, bu teknolojiyi sorumlu bir şekilde yönlendirmek açısından önemli.

Öyle sanıyorum son yıllarda en çok tartışılacak Nobel ödülü bu olacak…